Dall’ATS al “Talent System”: usare l’AI senza perdere il giudizio umano

A cura di Jacopo Paoletti

C’è un equivoco che torna spesso quando si parla di intelligenza artificiale nel recruiting: l’idea che il punto sia solo “assumere più in fretta”. È una promessa seducente, certo. Ma che detta solo così, appare ancora troppo piccola rispetto a ciò che realmente è.

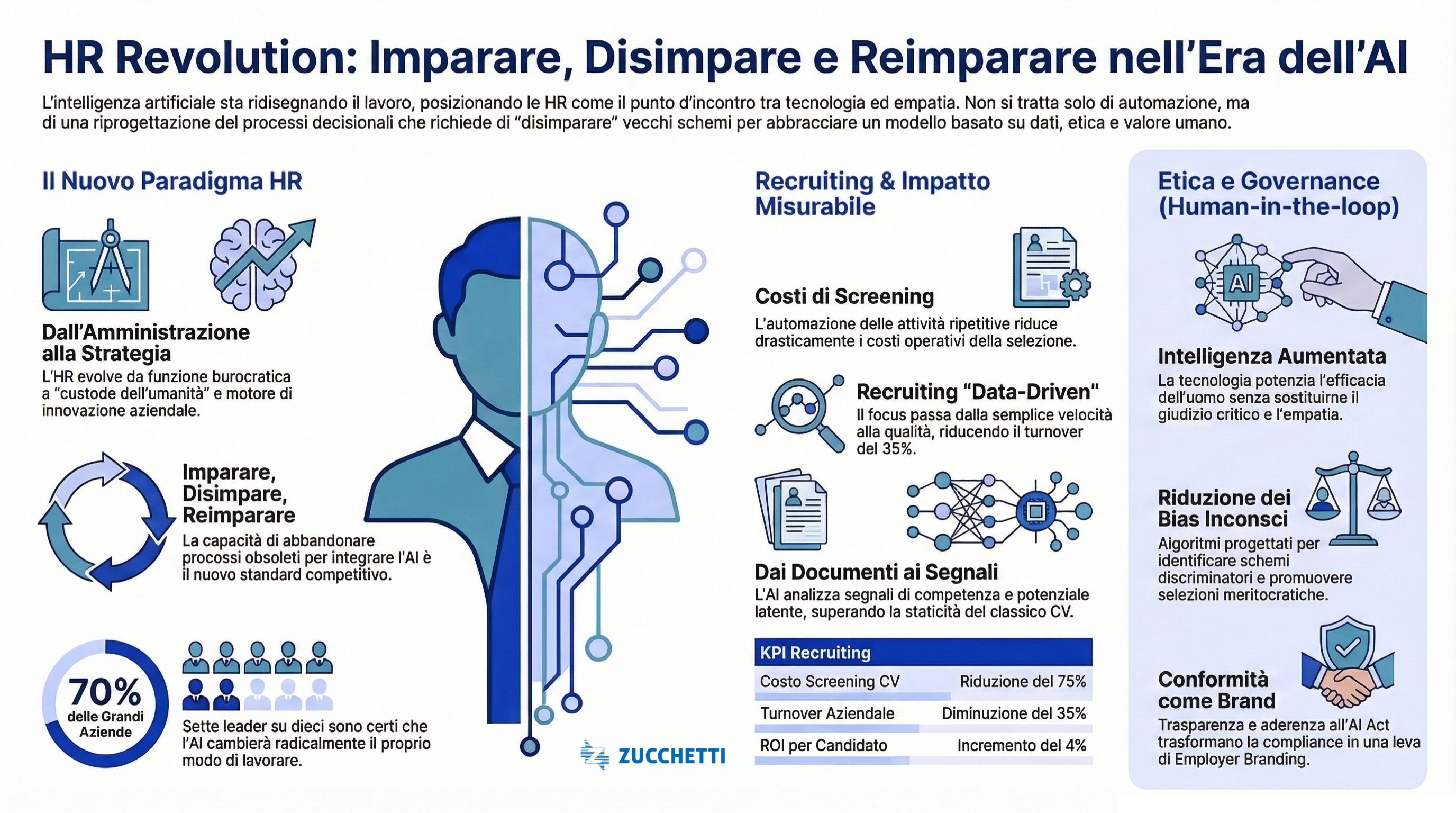

I numeri, peraltro, raccontano già una storia precisa: secondo il "Future of Recruiting 2025" di LinkedIn (basato su oltre un miliardo di profili in più di duecento paesi) il 60% dei professionisti della talent acquisition è convinto che l'AI migliorerà concretamente i risultati del recruiting, e il 95% dei hiring manager si aspetta un aumento degli investimenti nel settore nei prossimi dodici mesi. Un'altra ricerca di BCG condotta su CHROs a livello globale stima che il 92% delle organizzazioni stia già registrando benefici tangibili dall'AI in ambito HR, con oltre il 10% che dichiara incrementi di produttività superiori al 30%. Eppure (e qui sta il punto che merita attenzione critica) le organizzazioni che ottengono i miglioramenti più significativi non sono necessariamente quelle che hanno adottato più strumenti, ma quelle che hanno riprogettato i propri processi attorno ad essi, con metodo e intenzione. L'adozione senza architettura, insomma, produce volume. Ma non necessariamente qualità.

Il vero cambio di fase è quindi un altro: la selezione non è più (solo) valutazione di persone, ma progettazione di decisioni. E quando una decisione passa (anche parzialmente) da un sistema automatizzato, ciò che conta non è l’effetto speciale: é la fiducia (del candidato, dell’hiring manager, dell’azienda, oltre che del regolatore). Non è un caso che l’Europa abbia messo l’uso dell’AI in recruiting e selezione dentro la categoria dei sistemi “ad alto rischio”: non perché “l’AI è cattiva”, ma perché qui si gioca l’accesso al lavoro, quindi diritti, discriminazioni, opportunità reali. Questa classificazione non deve essere letta come un freno all'innovazione, bensì come l'istituzione di un nuovo standard di qualità. In un mercato globale dove la 'guerra per i talenti' è diventata una 'guerra per le competenze', l'aderenza ai principi di trasparenza previsti dall'AI Act trasforma la compliance da obbligo burocratico a leva di employer branding.

Le aziende che sapranno spiegare perché e come l'algoritmo ha analizzato un profilo saranno quelle che conquisteranno la fiducia dei candidati migliori, i quali oggi chiedono equità prima ancora che velocità.

Il punto non è “leggere i CV” ma distinguere i segnali

Molte organizzazioni hanno iniziato dall’ovvio: automatizzare attività ripetitive (screening, parsing, risposte standard, annunci). È utile, ma non basta (e infatti lo stesso ecosistema HR Expert ha già raccontato bene questi primi benefici e i relativi limiti, soprattutto quando l’AI prova a sostituire empatia e contesto). Il passo successivo (quello davvero strategico) è capire che il recruiting moderno non vive più solo di “documenti” (CV, cover letter e quant’altro), ma appunto di segnali:

- segnali di competenza (skill esplicite e implicite);

- segnali di apprendimento (come una persona migliora, non solo cosa ha fatto);

- segnali di aderenza al contesto (team, ruolo, modo di lavorare);

- segnali di motivazione (non misurabili con una parola chiave, ma osservabili in modo strutturato).

Qui l’AI può fare una cosa preziosa: ridurre il rumore e aumentare la leggibilità. In questo senso, dobbiamo immaginare l'AI come un acceleratore di 'intelligenza connettiva' capace di mappare non solo ciò che un candidato dichiara, ma il potenziale latente che emerge dall'incrocio tra esperienze diverse. Mentre il vecchio screening cercava la corrispondenza esatta, il Talent System moderno opera una traduzione semantica: comprende che un'esperienza di project management in un settore può essere il segnale perfetto per una posizione di coordinamento in un ambito completamente diverso. È il passaggio da una visione statica e retrospettiva della carriera a una predittiva e dinamica, dove la tecnologia abilita la mobilità interna e l'upskilling continuo. Ma per funzionare c’è una condizione: il processo deve essere progettato bene, altrimenti l’AI amplifica solo ciò che già era fragile.

Dove l’AI funziona davvero (e dove conviene fermarsi)

Se guardiamo con freddezza ai casi d’uso, l’AI rende al massimo quando:

1) Trasforma testo libero in dati utilizzabili

Non “capisce” le persone come farebbe un umano, ed è giusto e normale che sia così. Però può normalizzare informazioni sparse: competenze, esperienze, seniority, affinità con un profilo di ruolo, soprattutto se l’azienda ha una tassonomia di skill coerente.

2) Supporta il recruiter nel lavoro cognitivo “di mezzo”

La zona d’oro non è infatti la decisione finale (che è corretto resti sempre all’umano), ma è tutto ciò che la precede: sintesi di profili, confronto tra candidature, ricostruzione delle evidenze, preparazione di domande coerenti con criteri di valutazione, riassunto strutturato dei colloqui. (In breve: meno fatica amministrativa, più lucidità decisionale).

3) Migliora la candidate experience senza trasformarla in un call center

Può personalizzare comunicazioni, dare aggiornamenti puntuali, spiegare tempi e fasi, ridurre silenzi e ambiguità: la fiducia del candidato nasce spesso qui, non solo nella “grande” interview.

4) Fa emergere l’invisibile: bias, incoerenze, scarti sistematici

Se usata bene, l’AI aiuta a vedere pattern che un team solitamente non nota (o ha difficoltà a notare): shortlist che si “stringono” sempre sugli stessi profili, requisiti che escludono senza motivo, canali che producono volume ma non qualità. L'aspetto più dirompente di questo approccio è la capacità dell'intelligenza artificiale di agire come un audit permanente dei nostri processi mentali.

Quando il sistema evidenzia uno scarto sistematico, ci sta in realtà offrendo un feedback sulla nostra cultura aziendale nascosta. Utilizzare questi dati significa passare da una selezione basata sull'istinto a una basata sulle evidenze, dove il recruiter non è più un gatekeeper solitario, ma un architetto dei processi che utilizza i pattern algoritmici per sfidare i propri stessi pregiudizi e quelli degli hiring manager.

Dove invece conviene essere prudenti (o proprio fermarsi)?

- quando l’output è una classifica opaca (“questo sì, questo no”) senza spiegazione;

- quando si delega al sistema la valutazione di aspetti complessi (potenziale, cultura, attitudine) senza criteri espliciti;

- quando i dati storici riflettono scelte passate distorte: l’AI infatti non “corregge” la storia, ma tende a replicarla.

E qui serve ricordare una cosa scomoda: il bias non è un bug occasionale, è spesso un’eredità statistica. È anche per questo che, nel dibattito pubblico europeo, si stanno moltiplicando casi e attenzioni su discriminazioni algoritmiche (ad esempio sul targeting degli annunci di lavoro).

La variabile che decide tutto: governance (non tecnologia)

Nelle aziende, “governance” suona spesso come burocrazia. In realtà, nel recruiting, governance significa una cosa semplice: chi risponde di cosa. E qui la cornice europea è chiara: i sistemi di AI usati per attività di recruiting (targeting, filtro candidature, valutazione candidati) sono trattati come ambito sensibile e, quindi, richiedono controlli, trasparenza e responsabilità maggiori.

In parallelo, standard e organismi internazionali insistono sugli stessi principi: centralità umana, equità, trasparenza, robustezza, accountability. Questo cambio richiede che la governance non sia confinata ai dipartimenti legali o IT, ma diventi parte integrante del DNA delle Risorse Umane.

Parlare di centralità umana significa garantire la 'contestabilità' delle decisioni: ogni output generato dall'intelligenza artificiale deve essere la base per una conversazione informata, non un verdetto inappellabile. In questo senso, la tecnologia diventa robusta solo quando è accompagnata da una documentazione rigorosa e da una supervisione che sappia interpretare le sfumature culturali che sfuggono al codice.

Se volessimo tradurre tutto questo in pratica quotidiana per un team Talent, la domanda diventa: “Questo sistema rende il processo più giusto e più spiegabile, o solo più veloce?”

Checklist operativa: 10 domande prima di mettere l’AI in selezione

- Qual è il problema reale? Volume, qualità, time-to-hire, candidate experience, bias, coerenza tra hiring manager?

- Qual è l’unità di valutazione? CV, skill, evidenze, prove pratiche, rubriche strutturate?

- Che dati usa il sistema e da dove arrivano? (E cosa succede ai dati una volta processati?)

- Il candidato viene informato in modo comprensibile? Non “legalese”: chiarezza.

- C’è un “human-in-the-loop” vero? Cioè una persona che può capire, contestare, correggere.

- Cosa succede quando il sistema sbaglia? Escalation, override, log, apprendimento.

- Come misuro equità e qualità? Non solo KPI di efficienza: guardo anche scarti sistematici e coerenza delle decisioni.

- Quanto è spiegabile l’output? Se non posso spiegarlo a un candidato e a un manager, è un rischio reputazionale prima ancora che legale.

- Il modello è aggiornato al contesto? Ruoli, skill e mercato cambiano: anche gli assunti impliciti devono cambiare.

- Ho un punto di riferimento competente per i casi dubbi? (Nel lavoro reale, “dubbi” significa: sempre)

Su questo ultimo punto, non a caso servizi informativi come HR Expert includono anche canali di confronto con esperti e una struttura editoriale che integra aggiornamento normativo e pratiche organizzative: perché l’AI nel recruiting è, prima di tutto, una questione di processo e responsabilità, non soltanto di feature. La vera sfida che attende i professionisti HR non è dunque imparare a programmare, ma imparare a 'interrogare' la tecnologia con spirito critico. In un ecosistema integrato come quello proposto da HR Expert, la sinergia tra informazione normativa e strumento tecnico crea una rete di sicurezza che permette al recruiter di osare, spostando il focus dal controllo dei dati alla cura della relazione.

Non è un caso che l'aggiornamento costante e il confronto con esperti diventino i nuovi strumenti di lavoro: la tecnologia corre, ma è la consapevolezza organizzativa a dettare il ritmo del successo.

La conclusione che forse vale più di una “roadmap”

L’AI nel recruiting non sta “sostituendo” il recruiter: sta alzando l’asticella del mestiere. Il recruiter che farà la differenza non sarà quello che usa più tool, ma piuttosto quello che sa:

- definire criteri osservabili (non slogan);

- costruire processi tracciabili (non scorciatoie);

- proteggere la relazione col candidato (non automatismi freddi);

- rendere le decisioni difendibili (non solo rapide).

In altre parole: la Talent Acquisition diventa un lavoro di progettazione della fiducia. E questa è una buona notizia: perché la fiducia (a differenza della moda tecnologica) è una competenza che non invecchia, e che avrà sempre l’umano al centro.

Vale la pena osservare che questa trasformazione non è uniforme a livello internazionale, e che l'Italia porta con sé specificità proprie che ne rendono il percorso al tempo stesso più complesso e più ricco di opportunità. Il mercato del lavoro italiano è storicamente caratterizzato da una forte componente di discrezionalità informale nelle decisioni di hiring, da significativi disallineamenti tra competenze disponibili e competenze richieste, e da una cultura ancora parzialmente da consolidare intorno alla valutazione strutturata e ai criteri osservabili. In questo contesto, l'adozione di strumenti di AI ben governati non rappresenta soltanto un aggiornamento tecnologico: è una maturazione della pratica professionale, un passaggio da una selezione basata sull'intuito non documentato a una fondata su evidenze tracciabili e difendibili.

Soluzioni costruite per accompagnare l'intero ciclo di talent acquisition (dall'attraction all'onboarding, con funzionalità di AI nativa integrate nell'ecosistema HR aziendale) rappresentano esattamente questa tipologia di infrastruttura: non un sostituto del giudizio umano, ma un amplificatore della sua qualità, a condizione che chi lo utilizza sappia cosa chiedergli e perché. Il recruiter che comprende questa distinzione (e che vede lo strumento non come una scorciatoia ma come un moltiplicatore di rigore professionale) non è il recruiter del futuro. È il recruiter di adesso, già operativo a un livello qualitativamente diverso rispetto a chi attende ancora che la tecnologia "si stabilizzi" prima di confrontarsi seriamente con essa.

Jacopo Paoletti è manager, imprenditore e autore di "AI Economy — Economia, impresa e umano nell'era dell'Intelligenza Artificiale" (FrancoAngeli, 2025). Da oltre vent'anni lavora all'incrocio tra tecnologia, marketing e organizzazione d'impresa, ed è tra i pionieri in Italia nelle applicazioni dell'AI in ambito aziendale.

Riproduzione riservata ©