Recruiting nell’era dell’AI: quando la selezione diventa progettazione della fiducia

A cura di Jacopo Paoletti

C'è una scena che si sta ripetendo in migliaia di uffici HR in questo momento, e che nessuno descrive ancora con la chiarezza che merita.

Un candidato apre il suo laptop o sblocco il suo smartphone, carica il testo di un'offerta di lavoro su ChatGPT e chiede di ottimizzare il suo CV in funzione di quella posizione. Poi genera una lettera di presentazione personalizzata, la rilegge, la corregge un po', la manda. Dall'altra parte, il sistema ATS dell'azienda (sempre più spesso alimentato da un motore semantico di intelligenza artificiale) analizza quella candidatura, la confronta con un modello di profilo ideale, le assegna uno score, la inserisce o esclude dalla shortlist. Il recruiter apre il gestionale, vede una lista ordinata, prende in mano la situazione.

Il problema? I due algoritmi si sono già parlati. La persona vera non ha ancora incontrato nessuno. Questo non è un futuro distopico. È oggi. Ed è il punto di partenza (e non di arrivo) di una riflessione che il mondo HR fatica ancora ad affrontare con piena onestà.

Pertanto questa simmetria di automazione tra chi cerca e chi offre non è solo una sfida operativa, ma rappresenta il compimento di quella che potremmo definire una corsa alla tecnologia nel mercato del lavoro. In questo scenario, il 2026 segna il confine definitivo tra l’uso ingenuo dell’intelligenza artificiale e la maturità imposta da framework come l’EU AI Act. Le aziende non si limitano più a cercare l’efficienza, ma devono garantire l’accountability: ogni punteggio assegnato da un ATS deve essere spiegabile, trasparente e privo di discriminazioni sistemiche, trasformando il recruiting da semplice processo amministrativo a una complessa operazione di ingegneria etica e legale che non ammette approssimazioni.

I numeri dicono che la rivoluzione è già qui

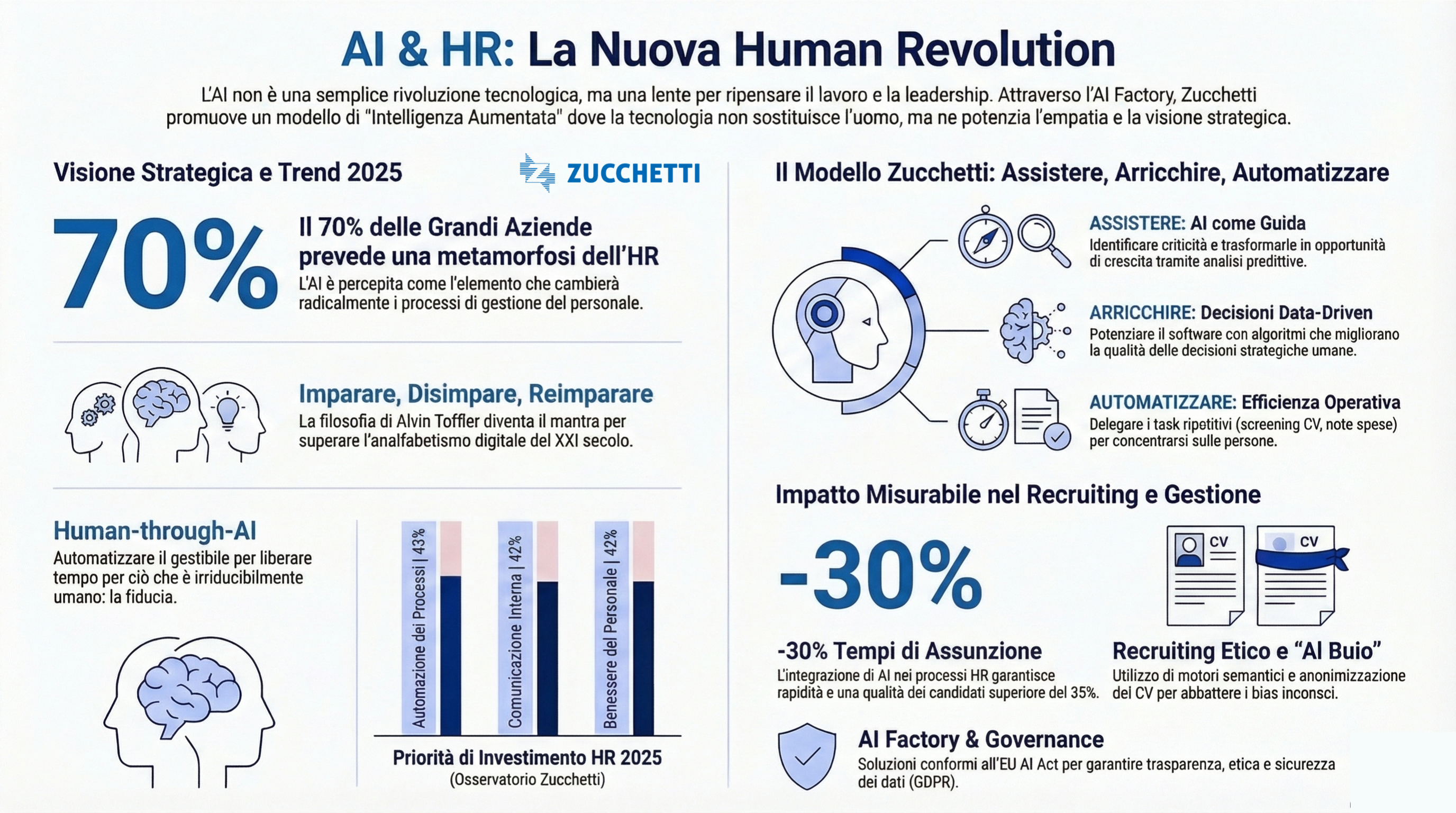

I dati più recenti sono inequivocabili. Il 43% delle organizzazioni nel mondo utilizza già l'AI per HR e recruiting, un balzo significativo rispetto al 26% dell'anno precedente. L'84% dei talent leader dichiara che la userà strutturalmente nel 2026. Il 52% sta pianificando di integrare AI agent autonomi all'interno dei propri team di talent acquisition. E secondo Gartner, entro il 2027 il 75% dei processi di selezione includerà assessment certificati sulle competenze in AI.

Nel frattempo, per effetto combinato dell'automazione e della saturazione del mercato, le candidature per posizione sono aumentate del 30%, mentre le posizioni entry-level si sono ridotte del 15%. Più candidati, meno posti, più AI nel mezzo. Questi numeri vengono spesso letti come un problema di volumi: più candidature da smaltire, più necessità di automazione. È un'interpretazione corretta, ma parziale. Perché il vero tema non è la quantità, ma più precisamente la qualità di ciò che stiamo misurando.

Il quadro italiano, per certi versi, amplifica questa contraddizione con un'acuità particolare. Secondo il nostro Osservatorio Zucchetti HR 2025 (l'indagine più rappresentativa del mercato nazionale, condotta su oltre 1.200 aziende di ogni dimensione e settore) solo il 56% delle grandi imprese utilizza oggi software evoluti per la selezione e la gestione dei CV, percentuale che crolla sotto il 30% nelle PMI. Significa che per una quota significativa delle organizzazioni italiane, il problema non è ancora la governance degli algoritmi, ma semplicemente l'adozione di una digitalizzazione di base.

E in questo divario tra le aziende più evolute (che già si interrogano su come calibrare e spiegare i propri sistemi di AI) e quelle che lavorano ancora con fogli di calcolo e caselle di posta condivise, si annida forse la vera fragilità strutturale del recruiting italiano: non la hybris tecnologica, ma la disomogeneità nell'affrontarla.

La domanda che forse nessuno si sta facendo

La discussione pubblica sull'AI nel recruiting si cristallizza ancora intorno a un'unica domanda: l'intelligenza artificiale sostituirà i recruiter? È sicuramente la domanda sbagliata. O almeno, è la meno urgente. La domanda più interessante (e forse più scomoda) è un'altra: se i candidati usano l'AI per ottimizzare come si presentano, e le aziende usano l'AI per lo screening, cosa stiamo davvero selezionando? La risposta onesta è: stiamo selezionando le persone più capaci di parlare efficacemente agli algoritmi. Non necessariamente le più adatte al ruolo, le più motivate, le più capaci di crescere nell'organizzazione. E c'è un nome per questo fenomeno in economia: si chiama selezione avversa.

In letteratura esiste anche un secondo principio complementare, noto come Legge di Goodhart: quando una misura diventa un obiettivo, cessa di essere una buona misura. Applicata al recruiting, la formulazione è immediata: nel momento in cui i candidati comprendono che un sistema ATS premia certi segnali (la densità di determinate parole chiave, la struttura del CV, la lunghezza e il tono della lettera di presentazione) quei segnali perdono progressivamente il proprio valore informativo. Non perché le persone stiano ingannando il sistema, ma perché si stanno adattando razionalmente a un meccanismo che non hanno scelto. La Legge di Goodhart e la selezione avversa sono due facce della stessa medaglia: entrambe descrivono cosa accade quando un dispositivo di misurazione viene esposto alla pressione adattiva di chi viene misurato. Il recruiting algoritmico, nella sua forma attuale, è esposto a entrambe.

In questo senso, quando il meccanismo di selezione premia chi sa ottimizzarsi per il processo di selezione, il processo perde progressivamente la capacità di misurare ciò per cui era stato progettato. Non è colpa dell'AI, ma di come viene usata, o meglio, di dove viene messa nell'architettura del processo. Il pericolo intrinseco in questa dinamica di ottimizzazione reciproca è la creazione di una vera e propria monocultura algoritmica. Se addestriamo i nostri sistemi a riconoscere solo determinati segnali di "eccellenza" e, parallelamente, i candidati imparano a proiettare esattamente quei segnali attraverso l'AI generativa, rischiamo di svuotare il talento della sua diversità cognitiva. Stiamo assistendo a una sorta di entropia del recruiting, dove la standardizzazione dei messaggi riduce drasticamente il segnale informativo reale, lasciandoci in mano profili perfetti sulla carta ma potenzialmente privi di quella resilienza e originalità che le sfide di mercato attuali richiedono con urgenza.

Dove l'AI è straordinaria, e dove meno

L'intelligenza artificiale nel recruiting ha vantaggi strutturali reali e documentati. Riduce i tempi di screening in modo drastico. Permette ricerche semantiche che vanno oltre il matching per parole chiave. Consente di ridurre alcuni bias sistematici nei processi di selezione, in particolare i bias legati all'ordine di lettura, alla percezione del nome o all'estetica del documento. Può analizzare pattern di successo su migliaia di assunzioni e restituire insight utili sulla previsione di performance.

Ma ha un limite strutturale che è bene riconoscere senza infingimenti: l'AI ottimizza per i pattern del passato. Le persone che sembrano più adatte a un ruolo secondo un modello addestrato su dati storici sono quelle che assomigliano a chi ha già avuto successo in quel ruolo. Il che significa che il talento atipico, la traiettoria non convenzionale, il profilo inatteso ma potenzialmente straordinario tendono ad essere sistematicamente sottopesati. E spesso, nella storia delle organizzazioni, sono proprio quelle le persone più preziose.

Questo limite strutturale dell'AI ci obbliga a ripensare il concetto stesso di posizione lavorativa, spostando l'asse dalle rigide Job Description verso una visione basata sulle competenze dinamiche, la cosiddetta Skills-Based Organization. In questo contesto, l'intelligenza artificiale eccelle nel mappare le hard skill esplicite, ma fallisce nel cogliere le "competenze latenti" e la capacità di cross-fertilizzazione tra settori diversi.

La vera sfida per l'HR contemporaneo è quindi utilizzare i dati non come un verdetto, ma come una bussola che indichi dove scavare più a fondo, cercando quei tratti di adattabilità e apprendimento continuo che un algoritmo, bloccato sui pattern del passato, non potrà mai prevedere con certezza assoluta.

Il vero ruolo delle persone nel 2026

Il recruiter del 2026 non è quindi scomparso. Anzi, ha cambiato e migliorato la sua funzione. E questa è, se vogliamo, la buona notizia. Quando l'AI gestisce ciò che è gestibile (la scala, la standardizzazione, la prima scrematura, la riduzione del rumore) libera inevitabilmente tempo e attenzione per ciò che è irriducibilmente umano: leggere la motivazione reale di una persona, valutarne il potenziale futuro e non solo il profilo presente, fare quelle domande che non stanno in un form strutturato, costruire la relazione che trasforma un candidato in un collaboratore ingaggiato. Secondo Korn Ferry, il 73% dei talent leader indica il pensiero critico come la priorità numero uno nelle competenze da ricercare nel 2026 (quindi non le skill tecnologiche, non la conoscenza dell'AI). Perché il pensiero critico è esattamente ciò che serve per usare bene l'AI: valutarne i suggerimenti, riconoscerne i limiti, sapere quando fidarsi dell'output e quando no.

C'è poi una dimensione del pensiero critico nel recruiting che raramente viene nominata, ma che oggi è diventata ineludibile: la capacità di leggere le candidature tenendo conto del contesto generazionale in cui sono state prodotte. La Generazione Z (che rappresenta oggi la quota crescente dei nuovi ingressi nel mercato del lavoro) ha un rapporto con le proprie candidature profondamente diverso da quello delle generazioni precedenti. Utilizza con naturalezza i tool di AI generativa, non percepisce come disonestà ottimizzare il proprio CV con il supporto di un modello linguistico, ma al tempo stesso porta aspettative molto più alte sulla qualità e sulla trasparenza dell'esperienza di selezione. Sempre l’Osservatorio Zucchetti HR 2025 rileva, per esempio, che solo il 27% delle aziende italiane inserisce la retribuzione attesa nell'annuncio di lavoro, nonostante questo sia il primo filtro che i candidati più giovani applicano per decidere se procedere o meno con la candidatura. Un recruiter che voglia fare bene il proprio lavoro nel 2026 non può limitarsi a saper leggere i suggerimenti di un algoritmo: deve saper leggere anche le persone che stanno dall'altra parte dello schermo: con la loro storia, le loro aspettative e i loro codici culturali.

Il punto, in sintesi, non è quindi human versus AI. È human through AI. Usare l'intelligenza artificiale per fare meglio le cose che possono essere automatizzate, e recuperare il tempo e lo spazio cognitivo per fare bene le cose che non lo possono essere.

L’importanza insostituibile del giudizio umano

La domanda che ogni HR director dovrebbe porsi oggi, concretamente, non è "quanta AI sto usando nel recruiting?" ma piuttosto "dove sto mettendo il mio giudizio umano, adesso che ho liberato del tempo?" Se la risposta è "in nessun posto di particolare rilievo, perché il processo è diventato più veloce ma strutturalmente uguale", allora il potenziale dell'AI nel recruiting è ancora largamente inespresso. E il rischio di selezionare le persone giuste nel modo sbagliato (o le persone sbagliate nel modo giusto) rimane aperto.

Integrare il giudizio umano all'interno di un workflow potenziato dall'AI (l'ormai noto approccio Human-in-the-loop) significa anche preservare la reputazione dell'azienda sul mercato. In un'epoca di estrema trasparenza, i candidati percepiscono immediatamente se il processo di selezione è una catena di montaggio automatizzata o un percorso di valore. L'eccellenza tecnologica, come quella espressa dalle piattaforme più evolute del nostro ecosistema, deve servire proprio a questo: eliminare l'attrito burocratico per restituire dignità al tempo del colloquio, rendendo l'esperienza del candidato un momento di reale scoperta del brand e della cultura aziendale, elementi che nessuna macchina può trasmettere con autenticità. Il recruiting è quindi, nella sua essenza, un atto di fiducia reciproca tra un'organizzazione e una persona. L'AI può rendere questo atto più efficiente. Non può, da sola, renderlo più vero.

Questo dipende ancora da noi.

Jacopo Paoletti è manager, imprenditore e autore di "AI Economy — Economia, impresa e umano nell'era dell'Intelligenza Artificiale" (FrancoAngeli, 2025). Da oltre vent'anni lavora all'incrocio tra tecnologia, marketing e organizzazione d'impresa, ed è tra i pionieri in Italia nelle applicazioni dell'AI in ambito aziendale.

Riproduzione riservata ©